Znajomość sprzętu i oprogramowania zapewnia wysoką wydajność wbudowanej sztucznej inteligencji

Sztuczna inteligencja (AI) stała się jednym z kluczowych czynników napędzających innowacje. Wysoka wydajność przetwarzania w chmurze umożliwiła wykorzystanie sztucznej inteligencji do tworzenia inteligentnych agentów, które mogą przejąć kontrolę i usprawnić ważne procesy biznesowe.

Christian Bauer, kierownik ds. marketingu produktów, Tria Technologies

Akceleratory sztucznej inteligencji

Twórcy i użytkownicy systemów wbudowanych, które kontrolują procesy przemysłowe i inne procesy w czasie rzeczywistym, mogą korzystać ze sztucznej inteligencji w chmurze. Istnieje jednak rosnące zapotrzebowanie na lokalne przetwarzanie AI w celu przezwyciężenia problemów związanych z koniecznością stałego i nieprzerwanego połączenia z serwerami w chmurze. Wielu dostawców półprzewodników zareagowało na ten problem, wprowadzając dedykowane akceleratory sztucznej inteligencji, często wbudowane w wielordzeniowe procesory ogólnego przeznaczenia.

Wydajność wbudowanych akceleratorów jest zazwyczaj ograniczona przez moc i powierzchnię krzemową, z której mogą korzystać. Oznacza to różnicę między możliwościami, jakie mogą zapewnić, a możliwościami dostępnymi w chmurze. Różnica ta staje się coraz bardziej widoczna wraz z trendem w kierunku dużych modeli generatywnej sztucznej inteligencji, które obecnie stanowią podstawę większości zastosowań agentowych i umożliwiły zastosowanie interfejsów użytkownika opartych na języku naturalnym w aplikacjach.

Stały rozwój wydajnej sztucznej inteligencji zaowocował powstaniem technologii takich jak MobileNet do rozpoznawania obrazów, które mogą zasilać modele potrzebne do zastosowań w dziedzinie bezpieczeństwa, handlu detalicznego, logistyki i automatyki przemysłowej. Podobne skupienie się na rozmiarze i wydajności obliczeniowej, w ramach którego programiści wykorzystali poprawę dokładności wynikającą z zastosowania większych zestawów szkoleniowych, zaowocowało powstaniem generatywnych implementacji sztucznej inteligencji, które mogą zastąpić znacznie większe modele, takie jak Llama2-7B. Na przykład TinyLlama wymaga mniej niż 3 miliardy parametrów.

Optymalizacja sprzętu

Rozwój bardziej usprawnionych modeli sztucznej inteligencji przebiegał równolegle z optymalizacją sprzętu, która pozwala uzyskać wysoką przepustowość na bardziej ograniczonym sprzęcie. Qualcomm jest jednym z czołowych specjalistów w tej dziedzinie. Jego zespół przeprowadził szeroko zakrojone oceny technik, takich jak przycinanie i mikroskalowanie, które pozwalają wyeliminować obciążenie obliczeniowe. Na przykład mikroskalowanie zastępuje operacje zmiennoprzecinkowe bardziej wydajną sprzętowo arytmetyką całkowitoliczbową opartą na mniejszych operandach. Niedawne przejęcie firmy Edge Impulse, specjalizującej się w dostosowywaniu sztucznej inteligencji do sprzętu o niskim poborze mocy, wzbogaciło te prace.

Dzięki temu firma Qualcomm uzyskała dogłębną wiedzę na temat technik optymalizacji modeli, które obecnie rozszerzają się na generatywną sztuczną inteligencję. Zespół inżynierów Qualcomm odegrał kluczową rolę w udoskonaleniu koncepcji dekodowania spekulatywnego jako sposobu na poprawę opóźnień i wydajności dużego modelu językowego (LLM). Technika ta dzieli wykonanie między mały model lokalny a model oparty na chmurze w sposób, który przyspiesza ogólne wykonanie.

Zrozumienie dekodowania spekulatywnego i innych funkcji sztucznej inteligencji zoptymalizowanych pod kątem zastosowań brzegowych i wbudowanych wpłynęło na architekturę sprzętową opracowaną przez Qualcomm w ciągu ostatniej dekady. Sprzęt ten, wdrożony początkowo na platformie smartfonów Snapdragon, obecnie rozszerza się na automatyzację przemysłową dzięki rodzinie Dragonwing.

Optymalizacja modelu ma swoje ograniczenia, jeśli chodzi o przenoszenie wysokowydajnych modeli sztucznej inteligencji na platformy wbudowane. Procesory Snapdragon i Dragonwing wypełniają tę lukę. Podczas gdy wiele konkurencyjnych rozwiązań może zapewnić przepustowość do 10 bilionów operacji na sekundę (TOPS), generacja IQ9 z rodziny Qualcomm może zapewnić ponad 100 TOPS. Daje to możliwość uruchamiania nie tylko TinyLlama i podobnych modeli LLM o zmniejszonym rozmiarze, ale także pełnego Llama2 z 13 miliardami parametrów. Te duże modele mogą działać z prędkością ponad 10 tokenów na sekundę, umożliwiając wykorzystanie lokalnej generatywnej sztucznej inteligencji do interfejsów języka naturalnego.

Optymalizacja energii

Optymalizacja energii to kolejna mocna strona architektury Hexagon, która stanowi podstawę wsparcia AI przez Dragonwing. Zapewnia ona ważne optymalizacje, które wydłużają żywotność systemów zasilanych bateryjnie między ładowaniami. Przykładem jest wnioskowanie mikro-kafelkowe, które wykorzystuje podstawową architekturę koprocesora Hexagon, zorganizowaną wokół silników wykonawczych, które współdzielą wspólną, centralną pamięć.

Wnioskowanie mikro-kafelkowe pozwala na długotrwałe działanie zmniejszonego modelu w stanie niskiego zużycia energii. Może to być wykorzystane do określonych rodzajów dźwięków lub ruchów na obrazie uchwyconym przez kamerę. Ten mały model może następnie aktywować bardziej zaawansowane zadania w celu oceny danych wejściowych. Architektura wspólnej pamięci pozwala programistom w pełni wykorzystać techniki takie jak łączenie warstw, które stosują MobileNet i inne modele. Dzięki przetwarzaniu wielu warstw jednocześnie, ich łączenie zmniejsza liczbę dostępów do pamięci zewnętrznej. Skutkuje to dużymi oszczędnościami energii w porównaniu z innymi architekturami i implementacjami.

Silniki wykonawcze Hexagon

Zawierają potoki dedykowane do arytmetyki skalarnej, wektorowej i tensorowej. Taka organizacja pozwala oprogramowaniu planować zadania w najbardziej odpowiedniej części koprocesora, aby w pełni wykorzystać możliwości przyspieszenia. Przepustowość wzrasta jeszcze bardziej dzięki obsłudze symetrycznego wielowątkowości. Jest to technika wykorzystująca równoległość na poziomie wątków w celu ukrycia opóźnień w dostępie do pamięci zewnętrznej. Za każdym razem, gdy jeden wątek musi czekać na pamięć, inny wątek, który już posiada wymagane dane, może działać do momentu, aż zostanie zmuszony do zatrzymania się, gotowy do przejęcia przez kolejny wątek.

Hexagon zawiera pełny procesor skalarny, który może obsługiwać system Linux. Pomaga to w zarządzaniu bardzo złożonymi potokami wielomodelowymi, które mogą funkcjonować bez konieczności korzystania z procesorów aplikacyjnych Arm, w które wyposażony jest również Dragonwing.

Procesory Dragonwing w rodzinie produktów SoM

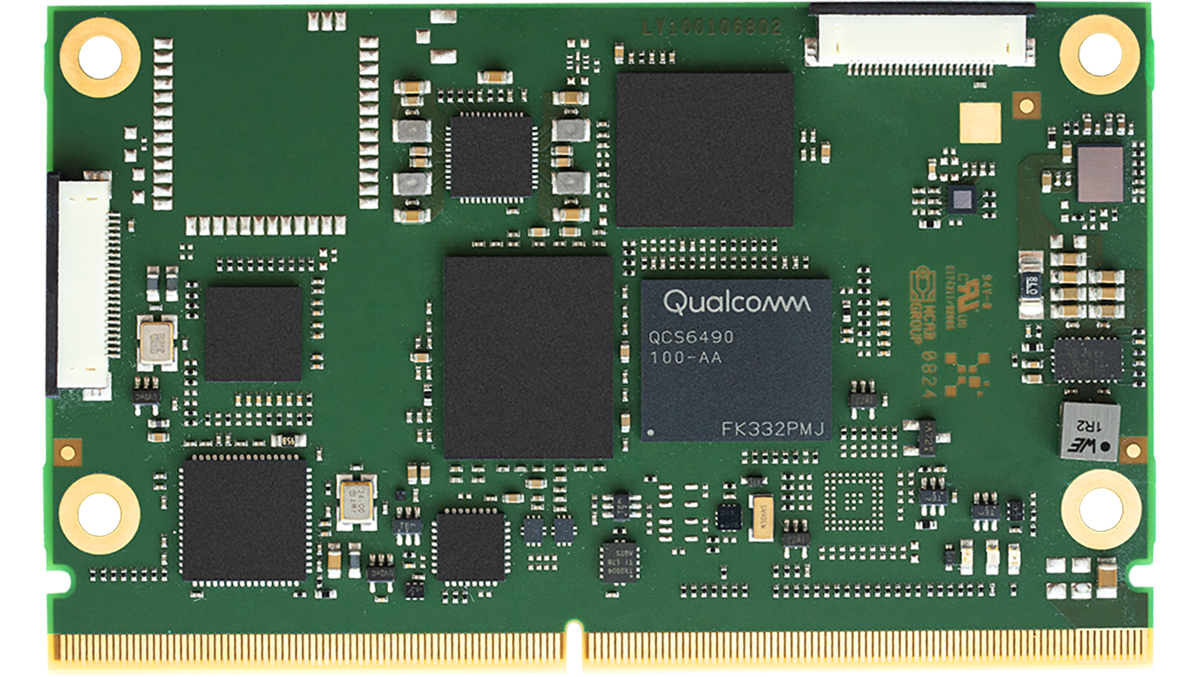

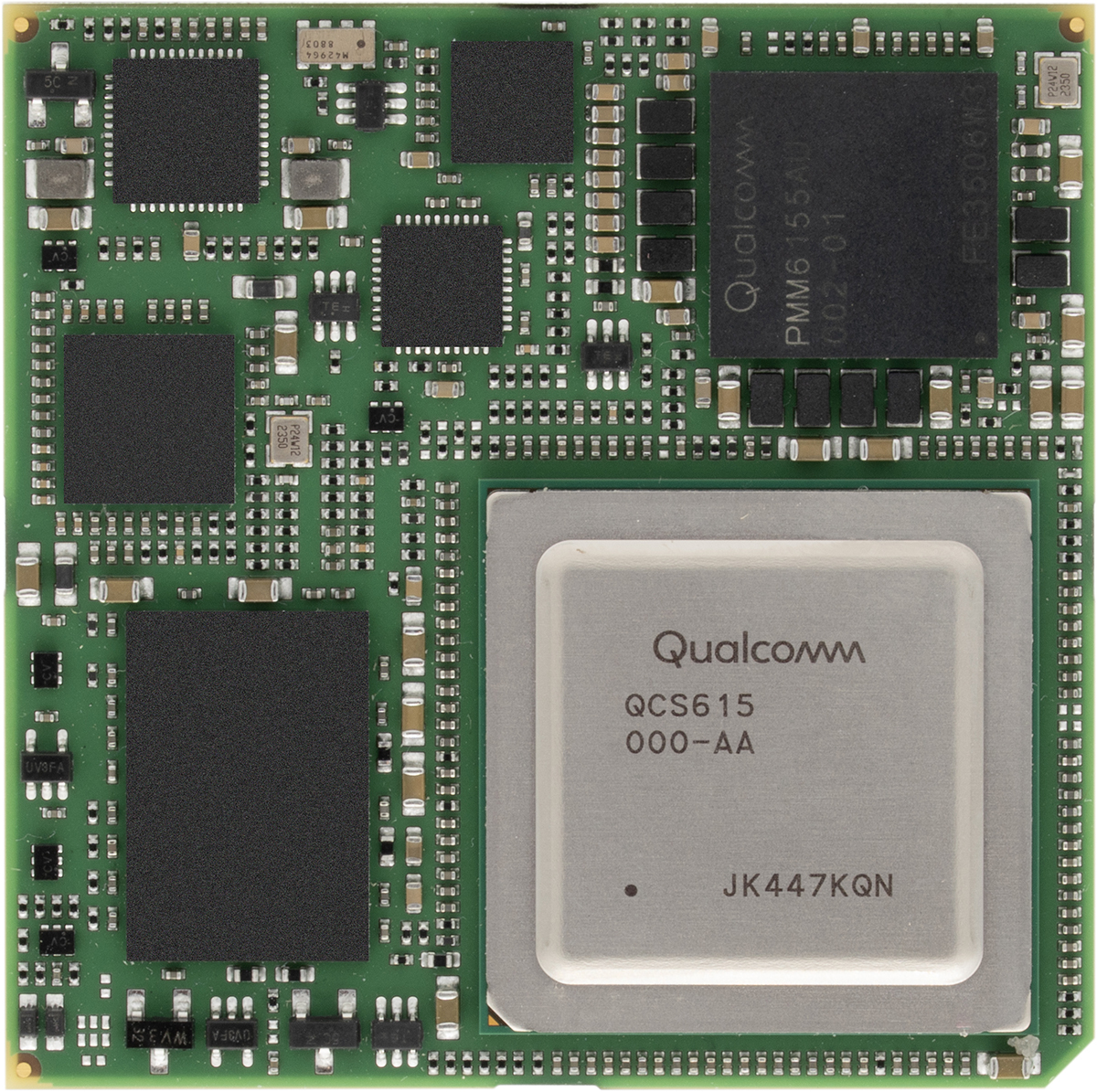

Włączenie procesorów Dragonwing przez firmę Tria do rodziny produktów typu system-on-module (SoM) zapewnia programistom łatwiejszy dostęp do tej technologii. W przypadku procesorów AI firmy Qualcomm, takich jak QCS5430 i QCS6490, firma Tria zdecydowała się zbudować płyty SoM w oparciu o popularną architekturę Smart Mobility ARChitecture (SMARC). Zastosowanie SMARC zapewnia programistom rodzinę modułów obsługujących sztuczną inteligencję, które mogą być wykorzystywane w produktach, w których rozmiar i przestrzeń mają kluczowe znaczenie, takich jak roboty mobilne.

Aby wykorzystać wysoką wydajność IQ-9075, kluczowego członka rodziny IQ9, firma Tria opracowała projekt komputera jednopłytkowego (SBC) o rozmiarze 3,5 cala, który zawiera pamięć LPDDR5 o przepustowości 36 MB/s oraz wysokowydajne interfejsy kamer oparte na standardzie MIPI. Moduły oparte na SMARC pozwalają projektantom wybierać spośród szeregu projektów opartych na Dragonwing, na procesorach QCS5430, QCS6490 i IQ6. Wykorzystując format OSM, moduł zbudowany w oparciu o IQ6 koncentruje się na projektach, które wymagają platformy AI o zoptymalizowanych rozmiarach. Płyty zbudowane w oparciu o platformę Snapdragon X Elite wykorzystują większe formaty ComExpress i ComHPC, aby umożliwić większą rozbudowę pamięci i wejść/wyjść, a nawet większą wydajność obliczeniową.

Zoptymalizowana konstrukcja

Cechą wspólną płyt zaprojektowanych przez firmę Tria jest ich konstrukcja, zoptymalizowana pod kątem termicznym i elektrycznym. Projektanci zweryfikowali działanie tych modułów w środowiskach o ograniczonych warunkach termicznych, dzięki czemu inżynierowie, którzy chcą z nich korzystać, nie muszą zgadywać, jak będą one działać w różnych warunkach, np. podczas pracy w bezpośrednim świetle słonecznym po zamontowaniu na słupie. Płyty oparte na Dragonwing oferują długi cykl życia wynoszący 13 lat lub więcej. Zastosowanie przez firmę Tria modułowego podejścia do projektowania pozwala również na skalowanie między generacjami produktów, ułatwiając aktualizacje i umożliwiając korzystanie z zamienników o wyższej wydajności.

Dzięki gotowej konstrukcji sprzętu, która nadaje się do integracji z produktami, czas wprowadzenia produktu na rynek ulega dalszemu skróceniu dzięki Qualcomm AI Hub. Oprogramowanie to zapewnia dostęp do setek różnych implementacji modeli, które zostały zoptymalizowane dla platform Snapdragon i Dragonwing. Użytkownicy muszą jedynie wybrać i pobrać modele, aby rozpocząć pracę z AI, co pozwala im wypróbować różne podejścia i sprawdzić, które najlepiej pasuje do docelowej aplikacji.

Wynikiem współpracy między Qualcomm i Tria jest połączenie wysokowydajnej akceleracji AI, infrastruktury oprogramowania zapewniającej dostęp do szerokiej gamy modeli AI oraz wsparcia sprzętowego, które pozwala programistom na jak najszybszą ocenę, prototypowanie i testowanie koncepcji. Platforma zapewnia użytkownikom z różnych branż, w tym automatyki przemysłowej, handlu detalicznego, bezpieczeństwa, logistyki i usług komunalnych, możliwość korzystania z najnowszych osiągnięć w dziedzinie AI.

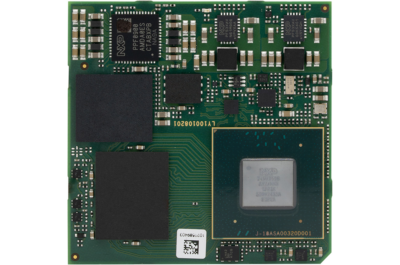

Tria Technologies wprowadza kompaktowy moduł OSM-LF-IMX95, oparty na procesorze aplikacyjnym NXP i.MX 95

Tria Technologies wprowadza kompaktowy moduł OSM-LF-IMX95, oparty na procesorze aplikacyjnym NXP i.MX 95  Elastyczne wykorzystanie sztucznej inteligencji na obrzeżach sieci

Elastyczne wykorzystanie sztucznej inteligencji na obrzeżach sieci  Nowa rodzina modułów obliczeniowych Tria z procesorami Qualcomm obsługuje teraz systemy Windows, Android i Linux

Nowa rodzina modułów obliczeniowych Tria z procesorami Qualcomm obsługuje teraz systemy Windows, Android i Linux