W kierunku inteligentniejszych silników predystorsji cyfrowej: podejście oparte na sieciach neuronowych

W artykule omówiono wyzwania związane ze zniekształceniami sygnału i nieefektywnością energetyczną wzmacniaczy mocy (PA) stosowanych w urządzeniach komunikacji bezprzewodowej nowej generacji. Przewidziano w nich wprowadzenie cyfrowego zniekształcania sygnału (DPD digital predistortion) opartego na sztucznej inteligencji. Tradycyjne metody DPD oparte na wielomianach borykają się ze złożonością obliczeniową i ograniczoną zdolnością adaptacyjną do nieliniowości i efektów pamięciowych. Stosując zaawansowane architektury sieci neuronowych, proponowany system dynamicznie optymalizuje predystorsję, przewyższając tradycyjne podejścia pod względem wydajności, zdolności adaptacyjnej oraz korekcji w czasie rzeczywistym. Pomimo wyzwań, takich jak interpretowalność modelu i zużycie energii, struktura ta udostępnia skalowalne i energooszczędne rozwiązania, stanowiąc znaczący postęp w projektowaniu nadajników RF dla nowoczesnych sieci komunikacyjnych.

Wprowadzenie

Wprowadzony przez OpenAI w listopadzie 2022 r. ChatGPT stał się jednym z najszybciej przyjętych produktów oprogramowania, pokazując potencjał sztucznej inteligencji (AI). Uczenie maszynowe (ML), będące podzbiorem AI, zmienia branże, umożliwiając wykonywanie zadań takich jak podejmowanie decyzji i analiza danych. W komunikacji AI i ML przyczyniają się do rozwoju cyfrowej predystorsji (DPD) – techniki kluczowej dla zmniejszenia zniekształceń sygnału i poprawy wydajności wzmacniacza mocy. Tradycyjne modele DPD mogą mieć trudności z nieliniowością i efektami pamięciowymi w nowoczesnych systemach komunikacyjnych, takich jak 5G. Zakładają one, że zachowanie PA jest statyczne i pozbawione pamięci. Rozwiązania te, opierając się na modelach wielomianowych, uwzględniają tylko chwilowe relacje między wejściem a wyjściem. Natomiast sztuczna inteligencja i uczenie maszynowe doskonale radzą sobie z uczeniem się złożonych wzorców, oferując bardziej precyzyjne rozwiązania. W dalszej części artykułu przedstawiono strukturę DPD opartą na sztucznej sieci neuronowej, która wykorzystuje dane uzyskane ze wzmacniacza mocy do redukcji błędów wzmocnienia/fazy, zwiększenia wydajności i poprawy charakterystyki widmowej. Rozwiązanie to przewyższa tradycyjne metody.

Zwiększenie wydajności wzmacniacza mocy PA: cyfrowe zniekształcenie wstępne (predystorsja) realizowane z innowacyjnym rozwiązaniem AI

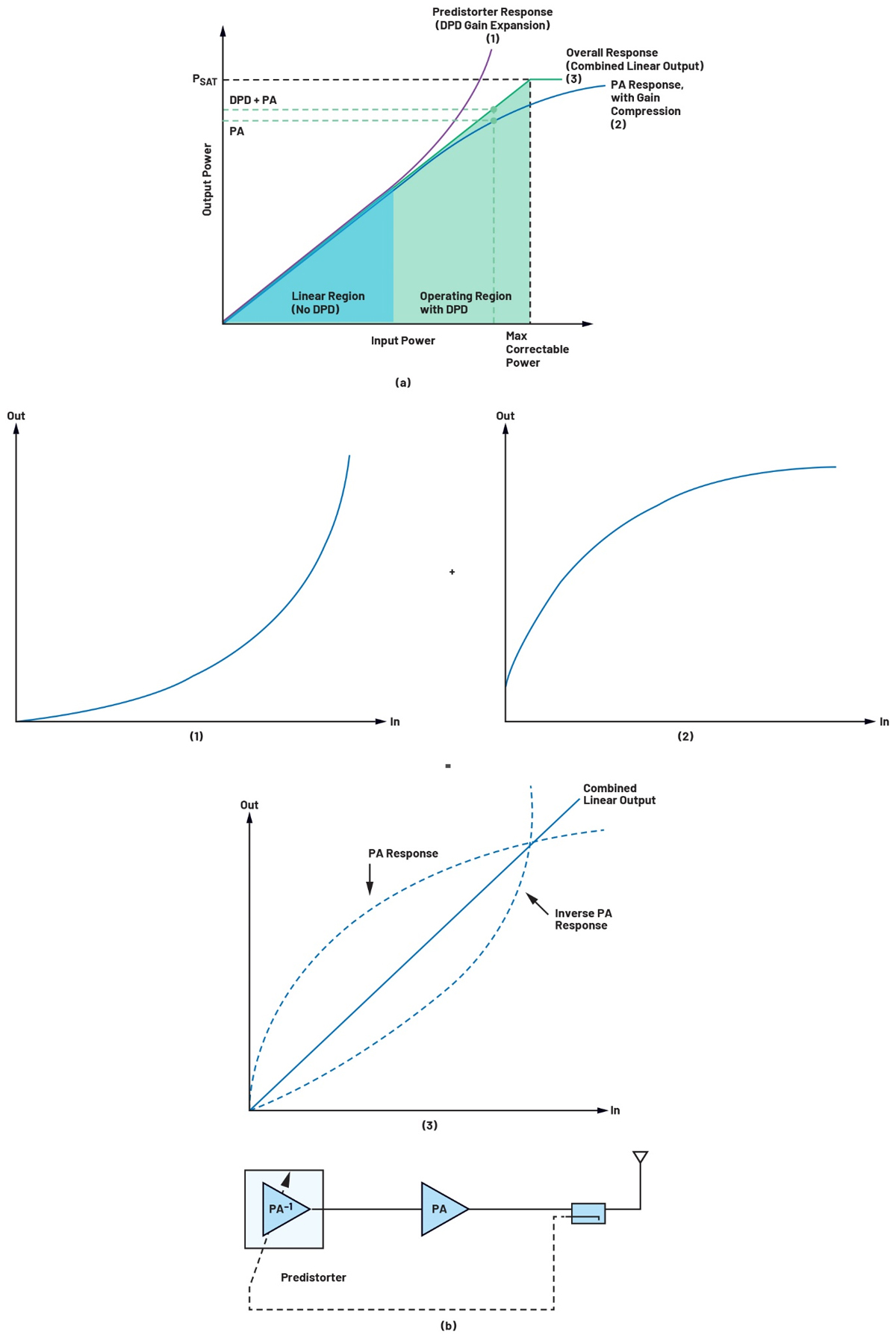

Cyfrowe zniekształcenie wstępne jest kluczową techniką umożliwiającą wzmacniaczom mocy wydajną pracę w pobliżu obszaru nasycenia bez utraty liniowości. Rozszerzając liniowy zakres pracy wzmacniacza mocy, technologia DPD pozwala projektantom urządzeń, w których występują częstotliwości radiowe (RF), wykorzystać wydajność nieliniowego wzmacniacza mocy przy zachowaniu liniowości sygnału nadawczego. Liniowość ta jest wymagana dla złożonych schematów modulacji, takich jak ortogonalna modulacja częstotliwości (OFDM).

Zasadniczo DPD działa poprzez wprowadzenie współczynników predystortera (układu zniekształcającego) pochodzących z modelowania odwrotnych charakterystyk amplitudy do amplitudy (AM-AM) i amplitudy do fazy (AM-PM) wzmacniacza mocy. Proces ten skutecznie kompensuje nieliniowości wzmacniacza mocy poprzez wprowadzenie precyzyjnego antyzniekształcenia przebiegu wejściowego. Szczegółową dyskusję obejmującą kilka zagadnień związanych z algorytmami DPD zamieszczono w artykule „Simplifying Your 5G Base Transceiver Station Transmitter Line-Up, Design, and Evaluation.”. Omówiono także jak transceiver RF ADRV9040 firmy ADI zapewnia uproszczoną platformę sprzętową do projektowania i wdrażania tych algorytmów. Koncepcję DPD, której celem jest liniowa transformacja odpowiedzi PA przedstawiono na rys. 1.

Rys. 1. Ogólna koncepcja DPD służąca do linearyzacji odpowiedzi wzmacniacza mocy: a) typowa krzywa AM-AM pokazująca ogólny obszar liniowy zaznaczony na zielono, b) podstawowa koncepcja DPD ilustrująca metodę poprawiania wydajności wzmacniacza mocy

Wzmacniacze mocy wykazują nieliniowości w pobliżu nasycenia, powodujące zniekształcenia sygnału, rozlewanie się widma (spectral regrowth) i zmniejszenie wydajności, zwłaszcza w systemach o dużej szerokości pasma z zaburzeniami, takimi jak nierównowaga I/Q i efekty pamięciowe. Sztuczna inteligencja i uczenie maszynowe, w szczególności sieci neuronowe (NN), zapewniają przełomowe rozwiązanie poprzez modelowanie zniekształceń PA i dynamiczną optymalizację predystorsji. Takie podejście oparte na sztucznej inteligencji poprawia wydajność i zdolność adaptacyjną, przewyższając tradycyjne metody, jednocześnie zapewniając równowagę między wydajnością a złożonością obliczeniową.

Optymalizacja silników DPD za pomocą modeli sieci neuronowych: proponowana przełomowa struktura

Sztuczne sieci neuronowe są podstawą sztucznej inteligencji, szczególnie w obszarze głębokiego uczeniu się, i zostały zaprojektowane w celu pokonania ograniczeń tradycyjnych algorytmów uczenia maszynowego. Sieci neuronowe, które są inspirowane zdolnością ludzkiego mózgu do przetwarzania informacji, doskonale radzą sobie z identyfikowaniem wzorców, uczeniem się i podejmowaniem decyzji. Dzięki temu idealnie nadają się do rozwiązywania złożonych problemów nieliniowych. Na przykład w systemach 5G LTE wyzwania takie jak nierównowaga I/Q, przesunięcia fazowe, offsety DC, przesłuchy i nieliniowość PA można skutecznie rozwiązać za pomocą podejścia DPD opartego na sieciach neuronowych.

W przeciwieństwie do rozwiązań DPD opartych na wielomianach, wymagających rozległej wiedzy na temat mechaniki systemu i borykających się z problemami skalowalności, modele sieci neuronowych doskonale radzą sobie ze złożonymi zachowaniami nieliniowymi, zapewniając przy tym mniejsze ograniczenia. Poniżej przedstawiono proponowaną strukturę sieci neuronowej DPD służącą do ograniczania nieliniowości i zakłóceń pracy nadajnika. Proces ten obejmuje trzy kluczowe etapy: charakteryzowanie wzmacniacza mocy i gromadzenie obszernych danych, uczenie modelu sieci neuronowej (postdistorter) oraz wdrażanie modelu wraz z monitorowaniem wydajności i korekty parametrów. Wykorzystując uczenie maszynowe, podejście to przekształca duże zbiory danych w praktyczne spostrzeżenia, umożliwiając tworzenie solidnych, skalowalnych rozwiązań dla współczesnych wyzwań komunikacyjnych.

Krok 1: Gromadzenie danych charakteryzujących wzmacniacz mocy

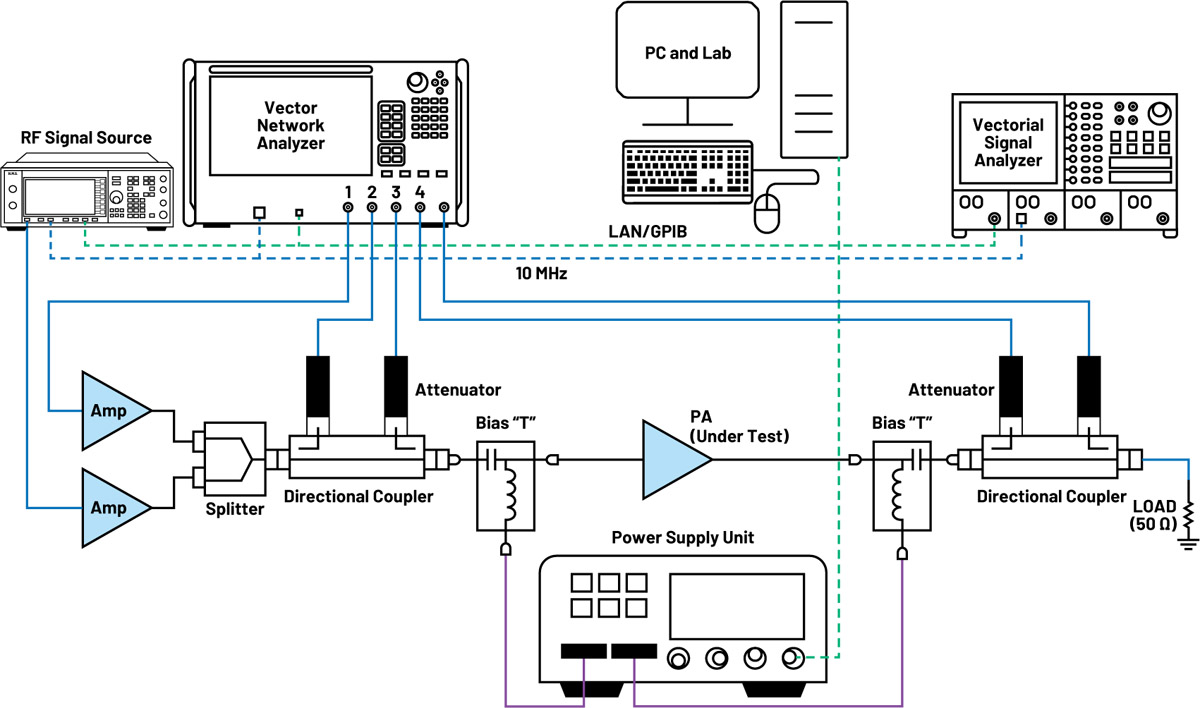

Aby zaprojektować i wdrożyć modele AI/ML do optymalizacji bezprzewodowych wzmacniaczy mocy, kluczowe znaczenie ma zebranie kompleksowych danych charakteryzujących o wysokiej jakości, które dokładnie odzwierciedlają rzeczywistą wydajność wzmacniacza mocy w różnych warunkach. Na rysunku 2 przedstawiono przykładową konfigurację, którą można zastosować do gromadzenia danych charakteryzujących wzmacniacz mocy.

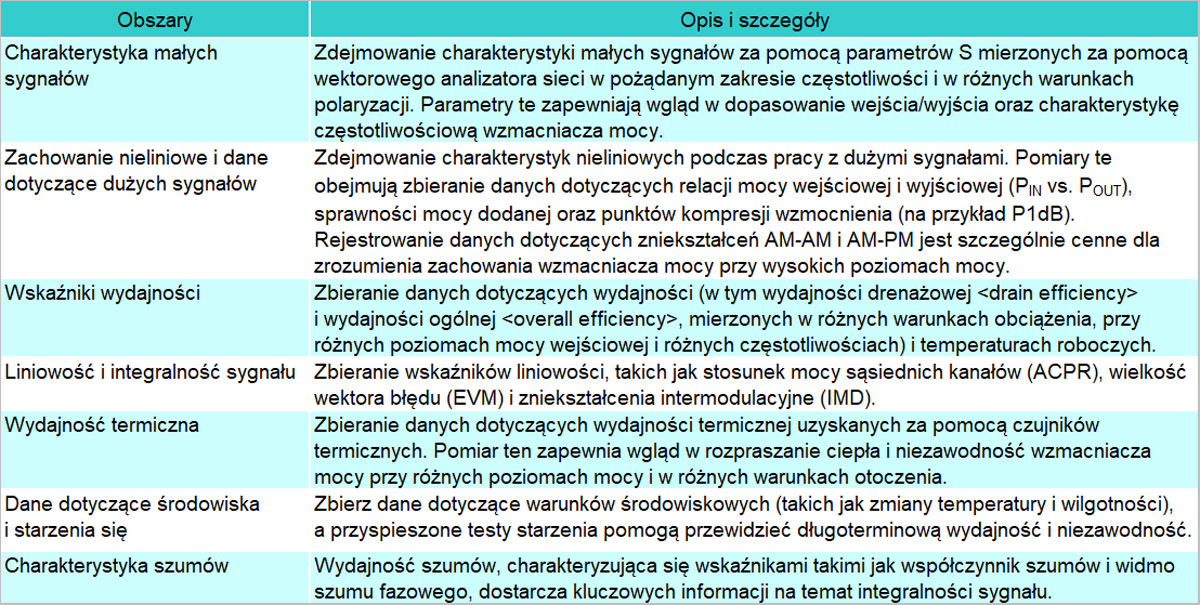

Konfiguracja stanowiska przedstawiona na rysunku 2 pozwala na uzyskanie pełnej charakterystyki poprzez wyodrębnienie s-parametrów, mocy dostarczanej, sprawności mocy dodanej (PAE – power-added efficiency), impedancji wejściowej, wejściowych strat odbiciowych, wzmocnienia mocy, konwersji AM-PM i innych. W tabeli 1 zamieszczono wyczerpującą listę punktów danych wprowadzanych do modelu. Należy jednak pamiętać, że wymiarowość modelu ma wpływ na jego czas reakcji. Ponadto zebrane dane muszą być zdygitalizowane, zanim będą mogły być wykorzystane w procesie szkolenia.

Rys. 2. Układ pomiarowy do zdejmowania charakterystyki szerokopasmowego wzmacniacza mocy

Tab. 1. Wykaz obszarów pomiarowych i ich opisy

To rygorystyczne i systematyczne podejście do gromadzenia danych stanowi podstawę do opracowania modeli AI/ML zdolnych do dokładnego przewidywania i optymalizacji wydajności PA. Wykorzystując ten kompleksowy zbiór danych, projektanci mogą tworzyć niezawodne i wydajne systemy komunikacji bezprzewodowej.

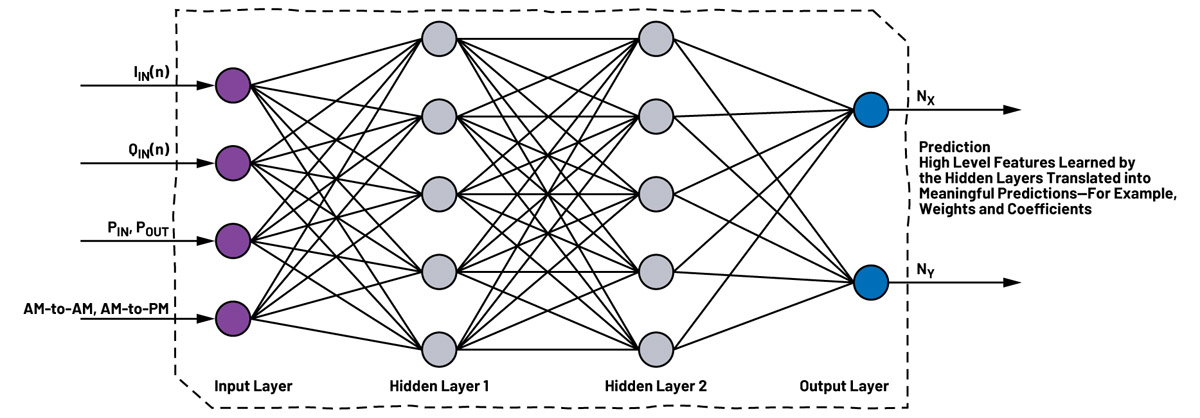

Krok 2: Trening modelu

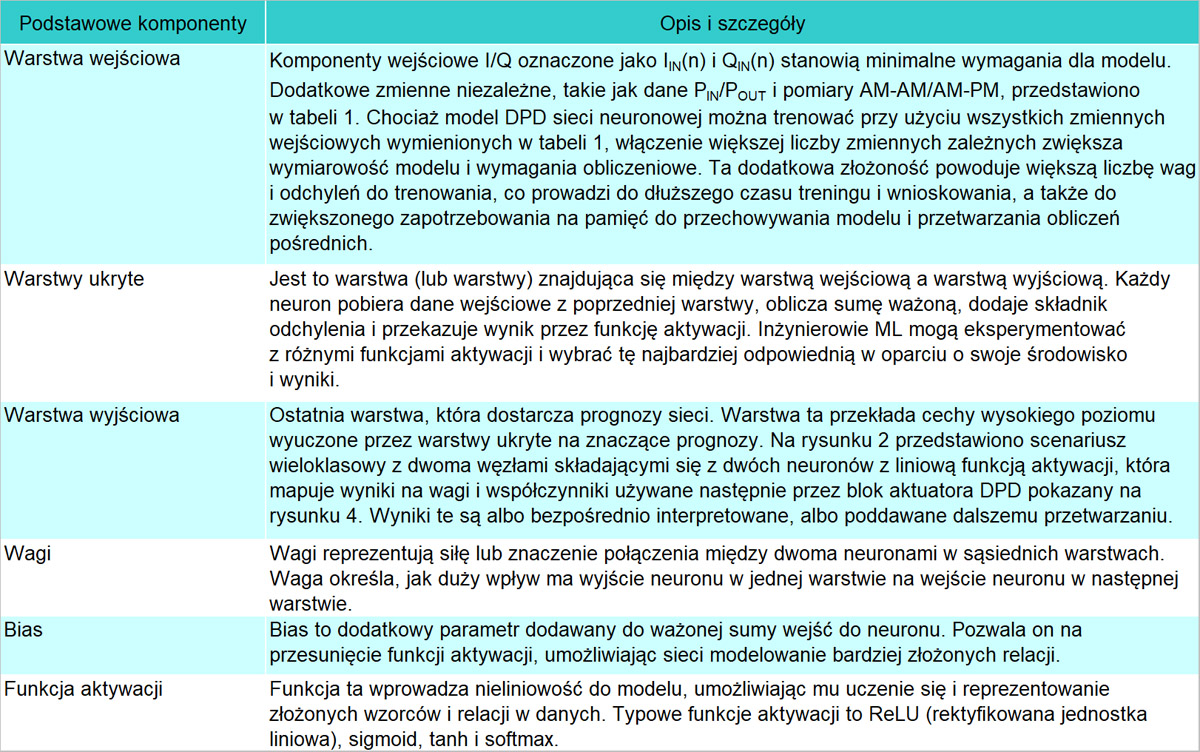

Proces treningu modelu polega na wprowadzeniu (niektórych lub wszystkich) sygnałów zebranych w tabeli 1 do tego systemu i optymalizacji modelu DPD w celu zminimalizowania błędu za pomocą funkcji straty. Architektura sieci neuronowej składa się z połączonych ze sobą warstw węzłów (na przykład sztucznych neuronów), zorganizowanych w główne komponenty rdzeniowe pokazane na rysunku 3.

Tab. 2. Komponenty rdzeniowe sieci neuronowej i ich opisy

Rys. 3. Architektura wieloklasowej sieci neuronowej do predykcji w uczeniu głębokim

Podczas uczenia warstwy ukryte przekazują dane do przodu, a wagi i odchylenia są optymalizowane poprzez propagację wsteczną z wykorzystaniem metody spadku gradientowego. Strukturę sieci można dostosować tak, aby zawierała więcej neuronów dla elementów wysoce nieliniowych lub mniej neuronów dla elementów o bardziej płynnej strukturze.

Chociaż dogłębna dyskusja na temat najlepszego sprzętu, oprogramowania i narzędzi AI do tworzenia skutecznego i skalowalnego środowiska szkoleniowego modeli AI wykracza poza zakres tego artykułu, zalecamy inżynierom AI zapoznanie się z KNIME, platformą bezkodową do analizy danych i uczenia maszynowego. KNIME ma graficzny interfejs użytkownika (GUI), który umożliwia użytkownikom projektowanie schematów działania poprzez proste przeciąganie i upuszczanie węzłów, eliminując potrzebę dysponowania rozległą wiedzą na temat kodowania. Schematy działania są bardzo wizualne i łatwe do zrozumienia, dzięki czemu platforma jest dostępna dla szerokiego grona odbiorców. Dla tych, którzy preferują podejście oparte na języku Python, Keras z TensorFlow® zapewniają znaczące korzyści. Łączą one prostotę Keras z solidnością i skalowalnością TensorFlow, co czyni je doskonałym wyborem dla projektów od eksperymentów po aplikacje głębokiego uczenia się na poziomie produkcyjnym.

W ramach charakteryzacji wzmacniacza mocy zostaną zebrane miliony próbek, z których 70% zostanie wykorzystanych do uczenia, a 30% do testowania i walidacji w celu oceny zdolności modelu do naśladowania zachowania PA. Wydajność modelu zostanie oceniona przy użyciu wskaźników takich jak dokładność, precyzja, czułość, miara F1 i ROC-AUC.

Krok 3: Walidacja i wdrożenie modelu sieci neuronowej

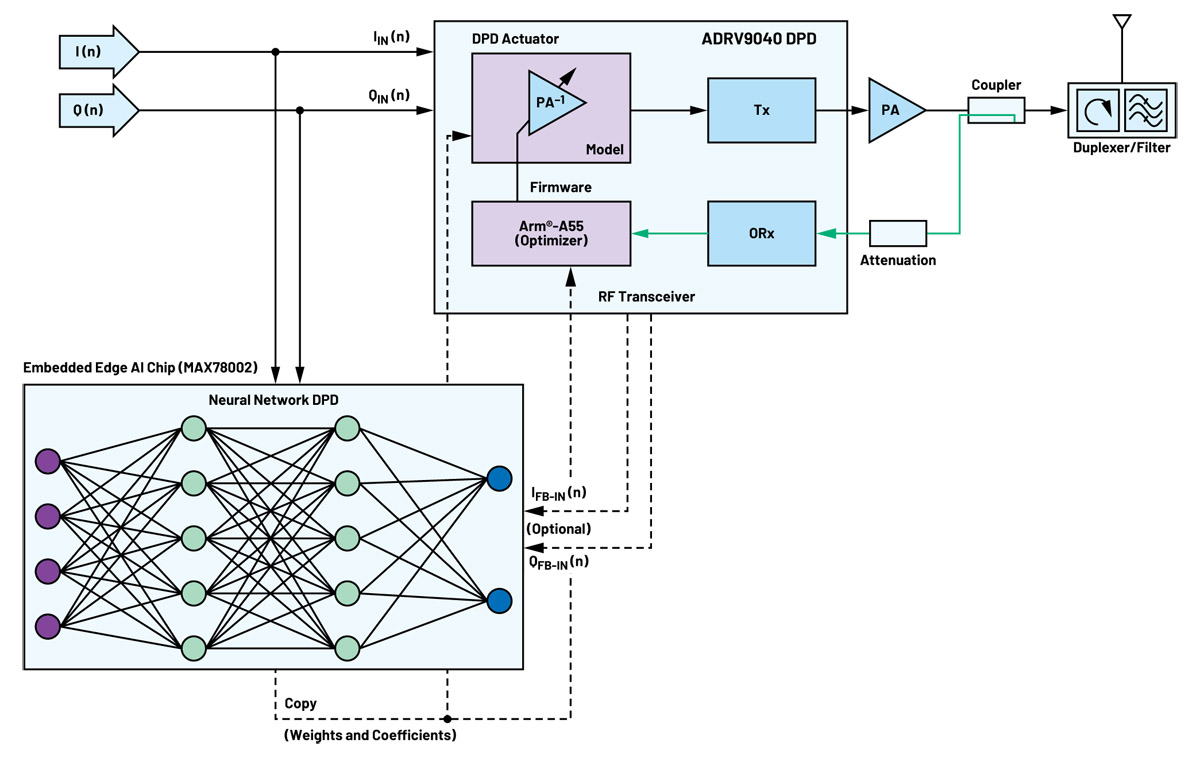

Proces wdrażania rozpoczyna się od walidacji modelu w celu zapewnienia jego jakości i dokładności, przy użyciu danych walidacyjnych do monitorowania jakości podczas uczenia i kryteriów zatrzymania, podczas gdy dane testowe niezależnie oceniają dokładność i uogólnienie. Rozwiązanie problemu nadmiernego dopasowania i niedopasowania ma kluczowe znaczenie dla zapewnienia dobrego uogólnienia modelu do nowych danych. Nadmierne dopasowanie można złagodzić poprzez ograniczenie liczby warstw, ukrytych neuronów lub parametrów w celu uproszczenia modelu. Stosuje się do tego celu rozszerzenie zbioru danych treningowych, a nawet poprzez przycinanie (na przykład usuwanie nadmiarowych neuronów, które nie mają znaczącego wpływu na wydajność) w celu poprawy uogólnienia. Z drugiej strony, złagodzenie niedopasowania można osiągnąć poprzez zwiększenie liczby ukrytych neuronów w celu zwiększenia złożoności modelu, poprzez dostosowanie hiperparametrów, takich jak tempo uczenia się, wielkość partii lub siła regularyzacji, w celu poprawy wydajności. Aby uzyskać solidny i podatny do uogólniania model, inżynier ML musi zrównoważyć te strategie i iteracyjnie oceniać wydajność modelu DPD zwracając przy tym uwagę na szybkość jego działania,. Na rysunku 4 zilustrowano ogólny schemat blokowy architektury systemu oceny modelu DPD sieci neuronowej.

W każdym przypadku określenie optymalnej liczby neuronów ukrytych wymaga badań empirycznych, prób i błędów lub metod adaptacyjnych podczas uczenia. Dostosowania te zapewniają osiągnięcie przez sieć neuronową odpowiedniej równowagi między złożonością a wydajnością, umożliwiając efektywne i skuteczne wdrożenie modelu. Wdrożenie modelu może być ułatwione dzięki wbudowanemu procesorowi MCU z technologią edge-AI, takiemu jak układ przyspieszający konwolucyjną sieć neuronową MAX78000 firmy ADI.

Integracja AI/ML z systemami DPD: wyzwania i możliwości

Integracja sztucznej inteligencji i uczenia maszynowego z systemami DPD zapewnia znaczny potencjał ulepszeń, ale wiąże się również z praktycznymi wyzwaniami. Systemy DPD wymagają niskich opóźnień i wysokiej prędkości przetwarzania, co może być trudne do osiągnięcia w przypadku modeli ML wymagających intensywnych obliczeń. Ponadto, w celu utrzymania optymalnej wydajności, dynamiczne warunki pracy, takie jak wahania temperatury i starzenie się sprzętu, wymagają technik adaptacyjnych, do których należy zaliczyć uczenie się w czasie rzeczywistym lub uczenie transferowe.

Kolejnym kluczowym czynnikiem jest efektywność energetyczna, ponieważ modele AI/ML, a zwłaszcza architektury głębokiego uczenia się, często zużywają więcej energii niż tradycyjne metody DPD. Sprawia to, że są one mniej odpowiednie dla środowisk wrażliwych na zużycie energii. Przyszłe eksperymenty powinny być przeprowadzane z wykorzystaniem lekkich sieci neuronowych, które są zoptymalizowanymi wersjami standardowych sieci neuronowych. Te lekkie sieci neuronowe są zaprojektowane tak, aby miały mniej parametrów, wymagały mniej obliczeń i były wydajne pod względem pamięci. Są one szczególnie przydatne w zastosowaniach, w których zasoby obliczeniowe są ograniczone, takich jak urządzenia mobilne i urządzenia Internetu rzeczy (IoT) lub inne systemy o ograniczonych zasobach.

Rys. 4. Schemat blokowy platformy oceny modelu sieci neuronowej DPD

Brak interpretowalności wielu modeli ML, zwłaszcza głębokich sieci neuronowych, dodatkowo komplikuje ich integrację z systemami DPD. Debugowanie i optymalizacja stanowią wyzwanie, gdy procesy decyzyjne są nieprzejrzyste, ponieważ modele te redukują złożone operacje do wag, odchyleń i funkcji aktywacyjnych.

Wnioski

Ponieważ technologie 5G, takie jak massive MIMO, wymagają mniejszego zużycia energii i większej precyzji, aby systemy DPD mogły sprostać nowym wyzwaniom, muszą ewoluować. Sztuczna inteligencja/uczenie maszynowe będą miały kluczowe znaczenie dla umożliwienia skalowalnych, energooszczędnych rozwiązań dzięki innowacjom, takim jak adaptacyjne uczenie się i modelowanie hybrydowe. Dzięki swojej zdolności do modelowania złożonych nieliniowości i efektów pamięci, sieci neuronowe upraszczają projektowanie systemów DPD poprzez aproksymację funkcji nieliniowych bez wyraźnych sformułowań matematycznych.

Integracja AI/ML zwiększa wydajność energetyczną, umożliwiając działanie wzmacniaczy mocy bliżej punktu nasycenia, jednocześnie obniżając koszty dzięki nieliniowym wzmacniaczom mocy. Pomimo wyzwań, systemy oparte na AI/ML są bardzo obiecujące pod względem zwiększenia dokładności, adaptacyjności i skalowalności systemów DPD. Podejścia hybrydowe, łączące tradycyjne metody oparte na wielomianach z technikami AI/ML, oferują zrównoważone rozwiązanie. Łączą przy tym interpretowalność klasycznych modeli z zaawansowanymi możliwościami AI/ML. Rozwiązując te wyzwania za pomocą innowacyjnych strategii, AI/ML może przyczynić się do transformacyjnych postępów w systemach DPD, wspierając ewolucję nowoczesnych technologii komunikacyjnych.

Opracowanie: Jarosław Doliński

Autor artykułu: Hamed M. Sanogo

Hamed M. Sanogo jest inżynierem w Customer Solutions Group (CSG) w Analog Devices, Inc. (ADI). Specjalizuje się w lotnictwie, obronności, komunikacji i centrach danych. Uzyskał tytuł magistra inżyniera elektryka na Uniwersytecie Michigan-Dearborn oraz tytuł magistra zarządzania biznesowego na Uniwersytecie w Dallas. Przed dołączeniem do ADI był starszym inżynierem projektantem w General Motors oraz starszym inżynierem elektrykiem w Motorola Solutions, gdzie kierował projektowaniem kart pasma podstawowego Node-B i RRU.

Przełączniki przemysłowe Analog Devices uzyskały certyfikat zgodności CC-Link IE TSN

Przełączniki przemysłowe Analog Devices uzyskały certyfikat zgodności CC-Link IE TSN  Analog Devices przedstawia CodeFusion Studio™ 2.0 do szybkiego tworzenia wbudowanych systemów AI

Analog Devices przedstawia CodeFusion Studio™ 2.0 do szybkiego tworzenia wbudowanych systemów AI  Analog Devices wprowadza na rynek ADI Power Studio i nowe narzędzia internetowe

Analog Devices wprowadza na rynek ADI Power Studio i nowe narzędzia internetowe