Intel Xeon 6 jako procesor hosta w systemach NVIDIA DGX Rubin NVL8

– Sztuczna inteligencja przechodzi od szkolenia na dużą skalę do wnioskowania w czasie rzeczywistym, wszędzie napędzanego przez agentową sztuczną inteligencję. W tej nowej erze procesor hosta ma kluczowe znaczenie. Zarządza on koordynacją, dostępem do pamięci, bezpieczeństwem modeli i przepustowością w systemach przyspieszanych przez procesory graficzne. Intel Xeon 6 zapewnia wydajność, efektywność i kompatybilność z rozbudowanym ekosystemem oprogramowania x86 – powiedział Jeff McVeigh, wiceprezes korporacyjny i dyrektor generalny ds. strategicznych programów centrów danych w firmie Intel.

Źródło: Intel

Dlaczego to ma znaczenie?

W miarę jak organizacje wdrażają systemy AI, wnioskowanie jest w coraz większym stopniu definiowane nie tylko przez przepustowość procesora graficznego (GPU), ale także przez wydajność systemu opartego na procesorze centralnym (CPU), przy czym procesor hosta kształtuje ogólną wydajność klastra i całkowity koszt posiadania. Odpowiada on również za kluczowe funkcje, takie jak zarządzanie pamięcią, koordynacja zadań i dystrybucja obciążeń, zapewniając jednocześnie bezpieczeństwo, niezawodność i ciągłość działania niezbędną dla nowoczesnej infrastruktury AI.

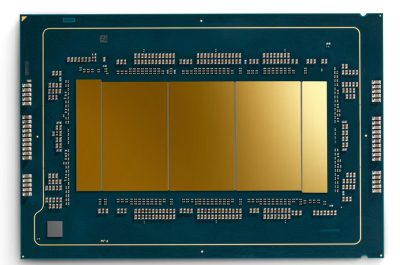

W oparciu o te wymagania na poziomie systemu, procesory Intel Xeon są wykorzystywane jako procesory hosta w systemach DGX Rubin NVL8 ze względu na ich zdolność do obsługi szybkich prędkości pamięci, zrównoważoną wydajność w szerokim zakresie obciążeń, niższy długoterminowy całkowity koszt posiadania (TCO) oraz dojrzały, sprawdzony w przedsiębiorstwach ekosystem oprogramowania. Ponadto możliwości Intel w zakresie PCIe i wejścia/wyjścia (I/O) dodatkowo wzmacniają rolę procesorów Xeon jako platformy o dużej przepustowości i niskim opóźnieniu w różnych obciążeniach.

Wzmocnienie rynkowe procesorów Intel Xeon

Wybór NVIDIA umacnia pozycję procesorów Intel Xeon jako fundamentu nowoczesnej infrastruktury AI, umożliwiając skalowalne wdrożenie w nowoczesnych centrach danych, chmurze i zastosowaniach brzegowych. Wraz ze skalowaniem wnioskowania AI, niezbędne staje się kompleksowe przetwarzanie poufne — od ścieżek danych procesora po procesory graficzne. Rozszerzenia Intel Trust Domain Extensions (TDX) zapewniają izolację sprzętową i poświadczanie, co dodatkowo wzmacnia wybór procesorów Xeon jako bezpiecznej podstawy dla nowoczesnych klastrów AI.

Nowa współpraca Intel i NVIDIA

Systemy NVIDIA DGX Rubin NVL8 integrują procesory Intel Xeon 6, opierając się na fundamentach architektury ustanowionych przez procesor Intel Xeon 6776P w obecnych platformach opartych na architekturze NVIDIA Blackwell, w tym w systemach DGX B300.

Intel zaprojektował procesory Xeon, aby pomóc tym systemom w pełni wykorzystać możliwości ich procesorów graficznych, wykorzystując funkcje takie jak Priority Core Turbo do utrzymania przepływu danych do procesorów graficznych – a dzięki wysokiej wydajności jednowątkowej w zakresie koordynacji, planowania i przenoszenia danych, procesory Xeon pomagają zapewnić płynne działanie nawet przy coraz bardziej złożonych obciążeniach związanych z wnioskowaniem.

Kluczowe cechy procesorów Intel Xeon 6:

- Pamięć systemowa o pojemności do 8 TB, obsługująca duże modele i rosnące pamięci podręczne KV;

- Trzykrotnie większa przepustowość pamięci w porównaniu z poprzednią generacją dzięki technologii MRDIMM1, poprawiająca szybkość przesyłania danych do procesorów graficznych;

- Magistrale PCIe 5.0 obsługujące akceleratory AI i inne urządzenia;

- Poufne przetwarzanie danych w ścieżkach danych między procesorem a procesorem graficznym dzięki funkcji Encrypted Bounce Buffer;

- Izolacja oparta na sprzęcie chroni dane i modele AI podczas ich użytkowania.

Intel i SambaNova planują wieloletnią współpracę w zakresie wnioskowania AI opartego na procesorach Xeon

Intel i SambaNova planują wieloletnią współpracę w zakresie wnioskowania AI opartego na procesorach Xeon  Światełko w tunelu dla Intela

Światełko w tunelu dla Intela  Grzegorz Kamiński: Trzech czy czterech dostawców najbardziej zaawansowanych chipów?

Grzegorz Kamiński: Trzech czy czterech dostawców najbardziej zaawansowanych chipów?