Interfejs mózg-komputer przywraca mowę: przełom neurotechnologii i AI

Neurotechnologia wkracza na nowy poziom. Interfejs mózg-komputer (BCI) wspierany przez sztuczną inteligencję przywraca mowę osobom sparaliżowanym. Jak to działa i co oznacza dla przyszłości komunikacji?

Czy możliwe jest mówienie bez użycia strun głosowych? Dzięki połączeniu implantów mózgowych z algorytmami AI odpowiedź brzmi: tak.

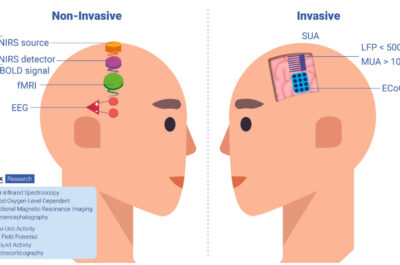

System opracowany przez naukowców z Uniwersytetu Kalifornijskiego w Berkeley i San Francisco działa w oparciu o implanty umieszczone w korze ruchowej mózgu. Te mikroelektrody rejestrują sygnały neuronalne powstające w momencie, gdy pacjent próbuje mówić. Zebrane dane trafiają do modelu AI, który dekoduje je na mowę syntetyczną w czasie rzeczywistym (opóźnienie poniżej 1 sekundy).

Czujnik na czaszce z wyszkolonym modelem AI, naukowcy z UC byli w stanie syntetyzować mowę w czasie rzeczywistym dla sparaliżowanych pacjentów. Źródło: All about Circuits, UC Berkeley

Co wyróżnia tę technologię?

- Odtwarza naturalny głos pacjenta na podstawie archiwalnych nagrań

- Działa niemal bez opóźnienia

- Pozwala na płynną konwersację

- To nie tylko pomoc technologiczna, ale prawdziwa rewolucja w rehabilitacji neurologicznej.

Studium przypadku: historia Ann Johnson

Po udarze mózgu Ann Johnson straciła zdolność mówienia na 18 lat. W 2023 roku została jednym z pierwszych pacjentów korzystających z nowej technologii BCI.

– Usłyszeć znów swój głos… to jak odzyskać część siebie – powiedziała Ann po pierwszej sesji z systemem.

Jej myśli przekształcane były na mowę z opóźnieniem mniejszym niż sekunda. Co więcej, AI wykorzystało nagrania z przeszłości, aby odtworzyć brzmienie jej głosu, nadając komunikatom emocjonalny wymiar.

Nowy standard komunikacji

W przeciwieństwie do klasycznych syntezatorów mowy, interfejs mózg-komputer nie bazuje na tekście wpisywanym przez pacjenta. Dekoduje intencje wypowiedzi bez potrzeby fizycznego ruchu czy pisania.

Zalety rozwiązania:

- Naturalna intonacja i tempo mowy

- Personalizacja na podstawie głosu pacjenta

- Zintegrowany system AI uczący się stylu komunikacji użytkownika

Technologia ta otwiera drzwi do zupełnie nowych zastosowań nie tylko w medycynie, ale też w edukacji i interfejsach człowiek-komputer.

Źródło: Informacje prasowe

Interfejs mózg-komputer przywraca mowę: przełom neurotechnologii i AI

Interfejs mózg-komputer przywraca mowę: przełom neurotechnologii i AI  Maszyny sterowane umysłem

Maszyny sterowane umysłem  Wizualizacja ludzkich myśli – IDTechEx bada interfejs mózg-komputer

Wizualizacja ludzkich myśli – IDTechEx bada interfejs mózg-komputer

![https://www.youtube.com/watch?v=BgxJVTwYJ-s Zapraszamy do obejrzenia filmu i wysłuchania krótkich wypowiedzi prelegentów Hardware Forum 2026 i organizatorów majowej konferencji dla inżynierów z branży elektronicznej: Konrad Bruliński z Lemontech, prof. Krzysztof Kulpa z Politechniki Warszawskiej, Zbigniew Huber z FLC, Ewa Załupska z firmy KROK, Jerzy Kozieł z MPTECH, Grzegorz Potyralski z VIGO Photonics, dr Krzysztof Czuba z Politechniki Warszawskiej, Anna Beata Kalisz Hedegaard z Quantum Security Defence, Adrian Cichosz z Elhurt Dystrybucja Anna Kamińska z Creotech Quantum, oraz Łukasz Jaeszke i Adam Jaeszke z TEK.day [materiał redakcyjny]](https://mikrokontroler.pl/wp-content/uploads/2026/05/tytulowe-film-1.png)